Management Summary

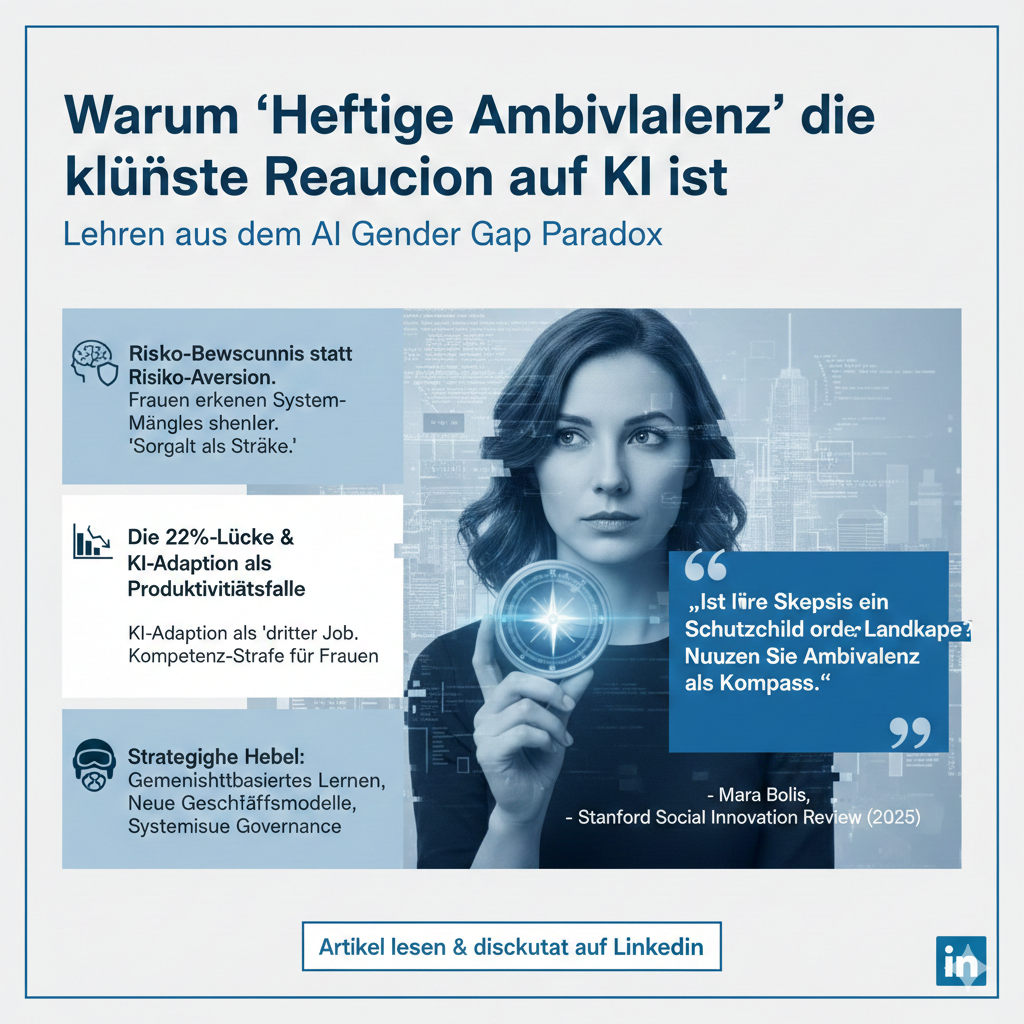

Eine Harvard-Meta-Analyse von 18 Studien mit 143.008 Personen aus 25 Ländern [1] zeigt: Frauen haben rund 22 Prozent geringere Chancen, generative KI zu nutzen als Männer – selbst wenn der Zugang gleich ist. Die vorschnelle Interpretation als „Technikscheu“ greift zu kurz: Frauen hinterfragen KI-Outputs kritischer und erkennen Halluzinationen häufiger [3]. Diese „Fierce Ambivalence“ [4] ist Risikobewusstsein, nicht Risikoaversion. Für Organisationen heisst das: Adoption-Quote ist ein irreführender Erfolgsindikator. Schulungen müssen kritische Urteilsfähigkeit ebenso fördern wie technische Kompetenz.

Für wen relevant?

HR und Diversity-Verantwortliche; Personalentwicklung und KI-Schulungs-Leitung; Führungskräfte mit Verantwortung für KI-Rollouts; Bildungspolitik und Hochschulen; Forschende zu KI und Arbeit.

Drei Kernaussagen

- Der 22-Prozent-Gap ist global stabil. Die Harvard-Meta-Analyse [1] zeigt: Der Gap besteht in nahezu allen Regionen, Sektoren und Berufen – sogar bei gleichem Zugang.

- Skepsis ist keine Schwachstelle. Häufigeres Hinterfragen, kritische Quellenprüfung und Risikobewusstsein sind Qualitätsindikatoren in einer Zeit halluzinationsanfälliger Modelle.

- Adoption-Rate ist die falsche Metrik. Wer KI-Erfolg nur am Nutzungsumfang misst, übersieht die Qualitätsdimension – und benachteiligt Skeptiker, die Fehler abfangen.

Aktuelle Erhebungen zeigen konsistent, dass Frauen KI-Tools seltener nutzen als Männer – die Lücke liegt bei rund 22 Prozentpunkten [1]. Die vorschnelle Interpretation lautet: mangelnde Kompetenz oder Technikscheu. Doch wer genauer hinschaut, findet ein differenzierteres Bild. Frauen äußern häufiger berechtigte Bedenken gegenüber KI-generierten Inhalten, hinterfragen Quellen kritischer und schätzen Risiken realistischer ein. Das Phänomen trägt einen treffenden Namen: Fierce Ambivalence [4] – entschlossene Zweifel.

Risiko-Bewusstsein versus Risiko-Aversion

Die Unterscheidung ist zentral: Risiko-Bewusstsein ist eine kognitive Stärke, Risiko-Aversion eine emotionale Blockade. Studien legen nahe, dass die zurückhaltendere KI-Nutzung von Frauen eher der ersten Kategorie zuzuordnen ist. Frauen erkennen häufiger die Grenzen von KI-generierten Antworten, sind skeptischer gegenüber halluzinierten Fakten und prüfen Ergebnisse gründlicher. In einer Zeit, in der unkritische KI-Übernahme zu teuren Fehlern führen kann, ist dieses Verhalten nicht rückständig, sondern vorausschauend. Unternehmen, die Adoption-Rates als einzigen Erfolgsindikator messen, übersehen diese Qualitätsdimension.

Die Produktivitätsfalle

Die Gleichung „mehr KI-Nutzung gleich mehr Produktivität“ ist ein gefährlicher Kurzschluss. Wenn KI-Tools Fehler produzieren, die erst spät im Prozess auffallen, kann die vermeintliche Zeitersparnis sich ins Gegenteil verkehren. Gerade in wissensintensiven Berufen – Medizin, Recht, Forschung – kann blinde KI-Übernahme schwerwiegende Konsequenzen haben. Die geschlechtsspezifische Nutzungslücke könnte sich paradoxerweise als Qualitätsvorteil erweisen, wenn Organisationen lernen, kritisches Hinterfragen als Kompetenz statt als Widerstand zu werten.

Was Organisationen daraus lernen sollten

Statt Gender-Gaps bei der KI-Nutzung einseitig als Defizit zu rahmen, sollten Unternehmen beide Perspektiven integrieren: die Bereitschaft zum Experimentieren ebenso wie die Fähigkeit zur kritischen Evaluation. KI-Schulungsprogramme, die allein auf Adoption zielen, greifen zu kurz. Was es braucht, sind Formate, die sowohl technische Kompetenz als auch kritische Urteilsfähigkeit fördern – und die anerkennen, dass Skepsis eine wertvolle Ressource in der KI-Transformation ist.

Quellen

Primärstudien und Meta-Analysen. Abruf: 27.04.2026.

- Otis, N. G.; Delecourt, S.; Cranney, K.; Koning, R.: Global Evidence on Gender Gaps and Generative AI. Harvard Business School Working Paper 25-023, 2025. hbs.edu (PDF)

- LeanIn.org: Women and AI: The Gender Gap in AI Adoption and Recognition. leanin.org

- Deloitte Insights: Women and generative AI: The adoption gap is closing fast, but a trust gap persists. 2025. deloitte.com

- Stanford Social Innovation Review: The AI Gender Gap Paradox. ssir.org

- UC Berkeley Haas: AI's Gender Gap. Haas Newsroom, Fall 2025. haas.berkeley.edu

Weiterlesen

Analysen wie diese in den Posteingang?

Der Newsletter bündelt die wichtigsten Beiträge des Monats. Kein Spam, kein Tracking.

Newsletter abonnieren